NVIDIA宣布推出全新H200 Hopper GPU,该GPU现在配备了全球最快的HBM3e内存。除了新的人工智能平台之外,NVIDIA还宣布凭借Grace Hopper超级芯片赢得超级电脑重大胜利,该芯片现已为Exaflop Jupiter超级电脑提供动力。

NVIDIA的H100 GPU是迄今为止业界需求量最大的AI芯片,但NVIDIA团队希望为其客户提供更高的性能。HGX H200是最新的AI HPC和运算平台,由H200 Tensor Core GPU提供支持。这些GPU在硬件和软件上均采用最新的Hopper优化,同时提供迄今为止世界上最快的内存解决方案。

NVIDIA H200 GPU配备了HBM3e解决方案,内存容量高达141GB,带宽高达4.8TB/s,与NVIDIA A100相比,带宽增加了2.4倍,容量增加了一倍。在Llama 2(700亿参数 LLM)等应用程序中,这种新的内存解决方案使NVIDIA的AI推理性能比H100 GPU提高了近一倍。TensorRT-LLM的最新进展也为大量人工智能应用带来了巨大的性能提升。

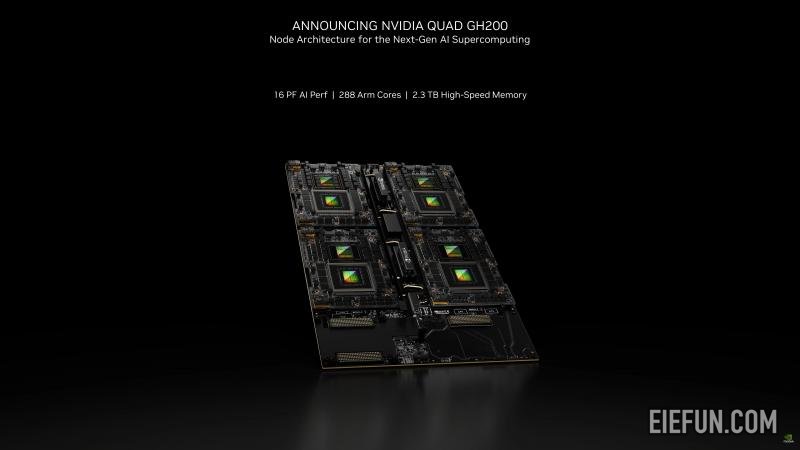

在解决方案方面,NVIDIA H200 GPU将广泛应用于有4路和8路GPU配置的HGX H200服务器中。HGX系统中H200 GPU的8路配置将提供高达32 PetaFLOP的 FP8运算性能和1.1TB的内存容量。

GPU也将与现有的HGX H100系统兼容,使客户能够更轻松地升级其平台。华硕、ASrock Rack、戴尔、Eviden、技嘉、慧与、鸿毅科技、联想、QCT、纬颖科技、超微和纬创等NVIDIA合作伙伴将在H200 GPU于2024年第二季上市时提供更新的解决方案。

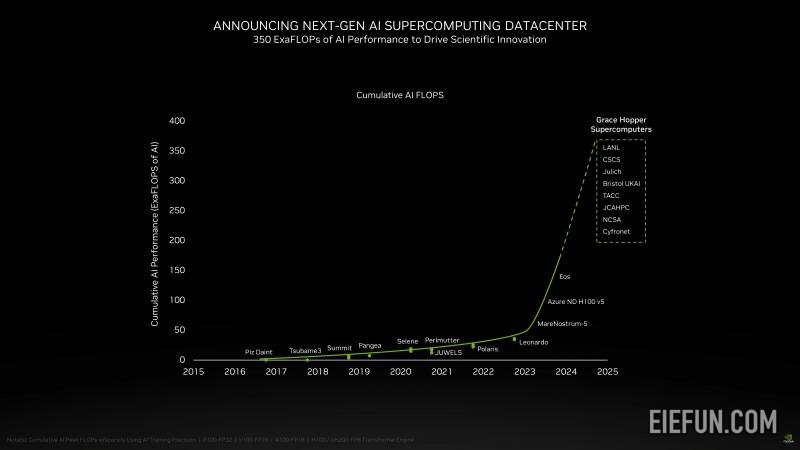

除了H200 GPU的发布之外,NVIDIA还宣布了由其Grace Hopper Superchips (GH200)提供支持的超级电脑的重大胜利。这款超级电脑被称为Jupiter,将位于德国于利希研究中心 (Forschungszentrum Jülich) 设施,作为EuroHPC联合计划的一部分,并由Eviden和ParTec承包。这款超级电脑将用于材料科学、气候研究、药物发现等。这也是NVIDIA在11月宣布的第二台超级电脑,前一台是Isambard-AI,可提供高达21 Exaflops的AI性能。

配置方面Jupiter超级电脑采用Eviden的BullSequana XH3000,采用全水冷架构。它拥有总共24,000个NVIDIA GH200 Grace Hopper超级芯片,这些芯片通过该公司的Quantum-2 Infiniband互连。考虑到每个Grace CPU包含288个Neoverse内核,我们认为光是Jupiter的CPU端就有近700万个ARM 内核(确切地说是 6,912,000个)。

性能指针包括90 Exaflops的人工智能训练和1 Exaflops的高性能计算。这款超级电脑预计将于2024年安装。总体而言这些是NVIDIA凭借强大的硬件和软件技术继续引领AI世界的一些重大更新。

免责声明

本文内容(图片、文章)翻译/转载自国内外资讯/自媒体平台。文中内容不代表本站立场,如有侵权或其它,请联系 admin@eiefun.com,我们会第一时间配合删除。